KI im Gesundheitswesen: Von der Früherkennung bis zur personalisierten Medizin

In deutschen Kliniken und Forschungseinrichtungen sorgt KI für einen Innovationsschub, der vor allem Patienten zugutekommt.

Ein Beispiel ist die KI-gestützte Diagnostik. Während Radiologen früher stundenlang Röntgenbilder oder MRT-Scans betrachteten und versuchten, kleinste Auffälligkeiten richtig zu deuten, analysieren KI-Systeme heute in Sekundenschnelle die Aufnahmen und erkennen dabei Muster, die selbst erfahrenen Fachleuten entgehen könnten. So werden etwa Tumore, Gefäßverengungen oder seltene Krankheitsbilder früher erkannt – was im Ernstfall Leben rettet.

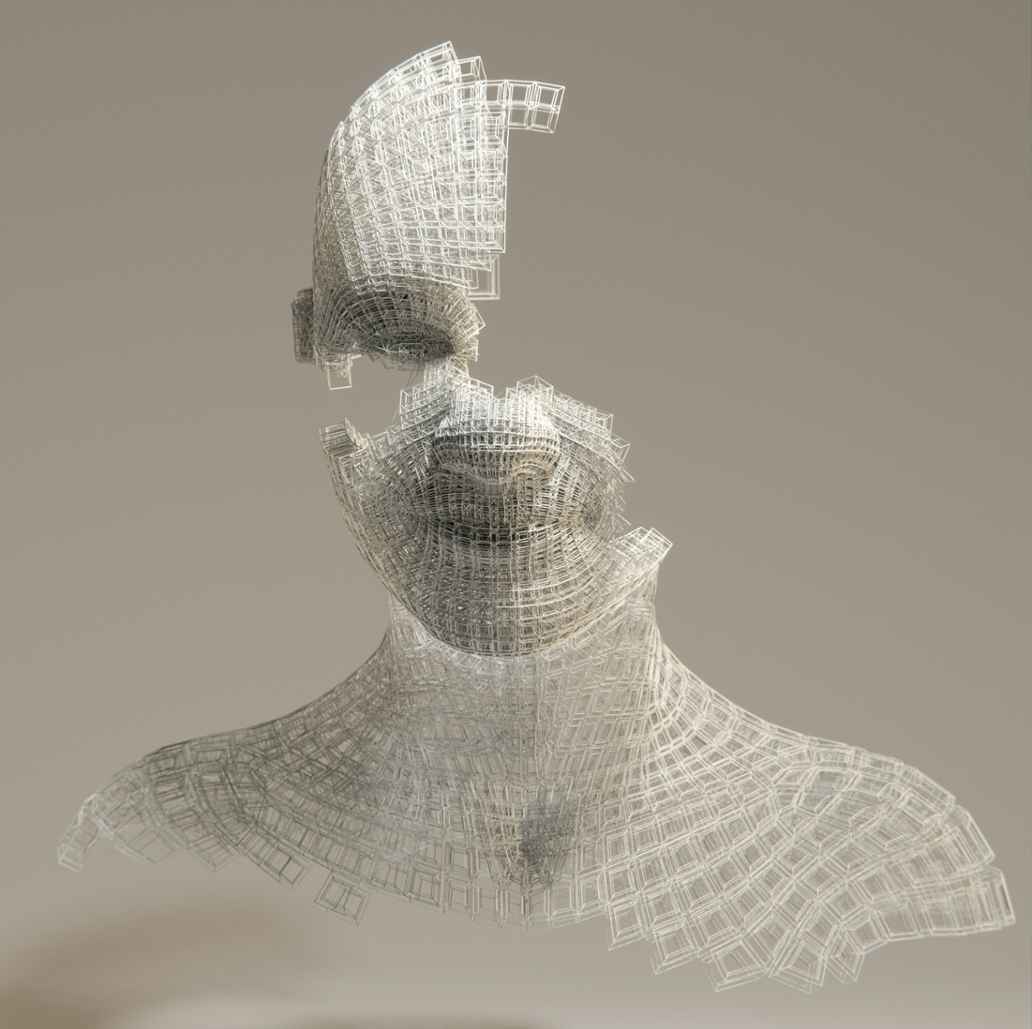

Digitale Abbilder ganzer Menschen – sogenannte digitale Zwillinge – sollen zukünftig die Simulation von Eingriffen oder Therapieplänen auf individueller Ebene ermöglichen. Im Rahmen der Strahlentherapie lassen sich bereits heute bestimmte Körperregionen digitalisieren, um die Therapie individuell so abzustimmen, dass möglichst kein gesundes Gewebe angegriffen wird. Auch Operationen an verschiedenen Organen können an digitalen Abbildern vorab erprobt werden. Ein vollständiges digitales Abbild der Patienten ist allerdings noch Zukunftsmusik.

KI für Umwelt und Nachhaltigkeit: Digitale Helfer im Kampf gegen den Klimawandel

Artensterben, Ressourcenknappheit und Umweltverschmutzung bedrohen unsere Lebensgrundlagen. KI bietet hier innovative Lösungsansätze.

Nehmen wir die Früherkennung von Waldbränden: Das Start-up Dryad Networks hat ein System entwickelt, das Brände in der Entstehungsphase erkennt und so hilft, wertvolle Ökosysteme zu schützen. In deutschen Wäldern überwachen mittlerweile Dryaden genannte KI-gesteuerte Sensornetzwerke die Gaswerte. Sie schlagen Alarm, sobald sich ein Waldbrand anbahnt – oft lange bevor Menschen oder klassische Technik etwas bemerken. Und ganz nebenbei werden die Daten auch noch analysiert, um das Wachstum des Waldes zu optimieren.

Auch in der Biodiversitätsforschung spielt KI eine wichtige Rolle. Sie kann Bild- und Tonmaterial analysieren und daraus Rückschlüsse auf die Veränderung von Populationen schließen. Der Vorteil liegt vor allem in der großen Menge an Daten, die so, ohne menschliches Zutun, ausgewertet werden können. Insbesondere aus Beobachtungen über einen längeren Zeitraum lassen sich dadurch deutlich einfacher Erkenntnisse ableiten.

KI in der Verwaltung: Effizientere Dienste für Bürgerinnen und Bürger

Die Verwaltung in Deutschland gilt allgemein als besonders schwerfällig und bürokratisch. KI bietet hier die Chance, Prozesse zu beschleunigen, Ressourcen effizienter einzusetzen und den Service für Bürger zu verbessern.

Ein besonders charmantes Beispiel dafür ist der digitale Bürgerassistent „Lumi“ aus Heidelberg. Lumi beantwortet Fragen rund um städtische Dienstleistungen, teilt beispielsweise den nächsten Abholtermin der Papiertonne mit oder informiert über alles Notwendige zur Wohnsitzummeldung. Basierend auf einem Large Language Model des Heidelberger KI-Start-ups Aleph Alpha funktioniert Lumi ähnlich wie ChatGPT dann am besten, wenn die Anfragen möglichst natürlich und in ganzen Sätzen formuliert werden. Lumi ermöglicht die Kommunikation mit Behörden auch für Menschen mit geringen Sprachkenntnissen, zumal die KI kontinuierlich dazu lernt und so auch ihre relevanten Fremdsprachenkenntnisse erweitert.

Ein kritischer Blick: Was ist schlecht an AI for Good?

So beeindruckend die Fortschritte im Bereich „AI for Good“ auch sind, sie haben ihren Preis – insbesondere in ökologischer Hinsicht. Der Energieverbrauch künstlicher Intelligenz ist in den vergangenen Jahren rasant gestiegen und entwickelt sich zunehmend zu einer Herausforderung für Nachhaltigkeit und Klimaschutz.

Der Grund dafür liegt im enormen Rechenaufwand, der für das Training und den Betrieb großer KI-Modelle erforderlich ist. Moderne Sprachmodelle wie GPT-4 oder Luminous werden mit Milliarden von Parametern trainiert und benötigen dafür gewaltige Mengen an Rechenleistung. Schlimmer noch: Der Rechenaufwand für das KI-Training verdoppelt sich etwa alle fünf Monate. Laut einer Öko-Institut-Studie im Auftrag von Greenpeace wird der Stromverbrauch von KI-Rechenzentren dadurch im Jahr 2030 elfmal so hoch sein wie noch vor zwei Jahren (2023). In einer Stadt wie Frankfurt am Main sind Rechenzentren schon heute für 30 % bis 40 % des gesamten Stromverbrauchs verantwortlich. Wird nicht gegengesteuert, so droht der zusätzliche Stromverbrauch die Klimaziele zu gefährden, da unter Berücksichtigung des aktuellen Tempos beim Ausbau nachhaltiger Energiequellen der zusätzliche Strombedarf nur durch längere Laufzeiten fossiler Kraftwerke gedeckt werden kann.

Doch der Energiehunger der KI hat noch weitere Folgen. Die Kühlung der Rechenzentren erfordert erhebliche Wassermengen. Dadurch verschärft die zunehmende Nutzung von KI die Konkurrenz um Wasserressourcen, was insbesondere in wasserarmen Regionen problematisch ist.

Und schließlich muss die Hardware in Rechenzentren – wegen des Verschleißes und um mit der technologischen Entwicklung Schritt zu halten – häufig ausgetauscht werden. Dadurch entstehen Tonnen von Elektroschrott und der Hunger nach seltenen grünen Erden, deren Abbau oft alles andere als nachhaltig ist, wächst.

Ein EU-Rechtsrahmen für mehr Verantwortung

KI-Systeme treffen zunehmend Entscheidungen, die das Leben von Menschen direkt beeinflussen – etwa bei Kreditvergaben, medizinischen Diagnosen oder im Justizwesen. Das wirft eine Vielzahl ethischer und gesellschaftlicher Fragen auf:

- Wer haftet, wenn KI-Systeme Fehler machen oder Schaden verursachen – Entwickler, Betreiber oder Nutzer?

- Was ist mit der Gefahr der Diskriminierung durch algorithmische Verzerrungen?

- Wie kann der mangelnden Transparenz begegnet werden?

- Was ist mit der potenziellen Gefahr der Verletzung von Grundrechten, z. B. durch den Missbrauch persönlicher Daten?

Um diesen Ängsten zu begegnen, setzt die Europäische Union auf einen umfassenden Rechtsrahmen. Die Datenschutz-Grundverordnung (DSGVO) verpflichtet bereits heute dazu, bei der Verarbeitung personenbezogener Daten durch KI-Systeme Grundsätze wie Rechtmäßigkeit, Zweckbindung, Transparenz und Datenminimierung einzuhalten. Darüber hinaus stärkt der EU AI Act, das weltweit erste umfassende KI-Gesetz, den Schutz von Grundrechten, indem er einen risikobasierten Ansatz verfolgt: Hochrisiko-KI-Systeme – etwa in der kritischen Infrastruktur oder im Bildungsbereich – unterliegen strengen Anforderungen an Transparenz, Sicherheit und erfordern menschliche Aufsicht sowie ein kontinuierliches Risikomanagement. Verboten sind KI-Anwendungen, die eine ernsthafte Bedrohung für Sicherheit oder Grundrechte darstellen, wie etwa manipulative Systeme oder solche zur sozialen Bewertung von Bürgern.

Angesichts der starken Abhängigkeit von außereuropäischen Technologieanbietern will die EU zudem mit Initiativen wie dem AI Act, dem Chips Act und dem „AI Continent Action Plan“ nicht nur sicherstellen, dass Europa seine digitale Zukunft eigenständig gestalten kann, sondern auch, dass die eingesetzte Technologie in Einklang mit den europäischen Werten wie Datenschutz, Demokratie und Rechtsstaatlichkeit steht.

KI als Chance – aber nicht um jeden Preis

„AI for Good“ ist mehr als ein Schlagwort. Die Vorteile sind spürbar, doch mit der neuen Technologie einhergehende Bürden dürfen nicht außen vor gelassen werden.

Gesetze und Verordnungen schaffen einen grundlegenden Rahmen für den Umgang mit neuen Technologien wie künstlicher Intelligenz (KI), doch sie entbinden Unternehmen nicht von ihrer eigenen Verantwortung. Gerade im Kontext rasanter technologischer Entwicklungen besteht die Gefahr, dass die Gesetzgebung hinter dem Fortschritt zurückbleibt. Staatliche Regulierungen, wie etwa der neue EU AI Act, definieren zwar Mindeststandards und verbieten bestimmte Hochrisiko-Anwendungen – etwa soziale Scoring-Systeme oder biometrische Echtzeit-Identifikation im öffentlichen Raum – doch bleiben sie immer auch ein Kompromiss zwischen verschiedenen Interessen und können ethische oder nachhaltige Ansprüche einzelner Unternehmen und der Gesellschaft nicht vollständig abdecken. Die Verpflichtung, Risiken zu erkennen, zu bewerten und zu minimieren, bleibt somit eine ureigene Aufgabe der Unternehmen. Sie sind gefordert, eigene Strukturen und Richtlinien zu etablieren, um einen verantwortungsvollen Umgang mit KI zu gewährleisten.

Mit Blick auf die Umweltauswirkungen sollte die eigene, oft übermäßige Abhängigkeit von digitalen Technologien, einschließlich KI, kritisch hinterfragt werden. Die überflüssige Anwendung digitaler Technologien ist eine der Triebfedern, die der oben beschriebenen Problematik zugrunde liegen.

Schließlich gilt: Nur wenn technologische Innovation und Nachhaltigkeit Hand in Hand gehen, kann KI ihr volles Potenzial zum Wohl der Gesellschaft entfalten. Nur dann wird aus „AI for Good“ tatsächlich auch „AI for a better world“.

Vielen Dank für den Kommentar!

Zur Veröffentlichung des Kommentars bitte den Link in der E-Mail anklicken.